Противостояние Министерства обороны с Anthropic по поводу интеграции искусственного интеллекта в военные операции и того, кто устанавливает ограничения на его использование, достигло апогея на этой неделе, когда министр обороны Пит Хегсет предоставил компании искусственного интеллекта срок до 17:01. Пятница, чтобы выполнить требования правительства. Никаких изменений в Anthropic, по крайней мере на сегодняшний день, не произошло, но битва между военными и промышленностью за ИИ только начинается. Пентагон сталкивается с частными компаниями, которые контролируют ИИ способом, который не был опробован в эпоху после Второй мировой войны.

В четверг Anthropic отклонила требование министра обороны Пита Хегсета ослабить некоторые меры безопасности в отношении своих моделей для военного использования, включая массовое домашнее наблюдение или полностью автономное оружие, поскольку это нарушает политику компании. Решение генерального директора Дарио Амодеи было принято после того, как Пентагон предупредил, что может прекратить партнерство, если компания откажется поддерживать «все законные виды использования».

«Выбор подрядчиков, которые соответствуют его видению, является прерогативой департамента», — написал Амодей в своем заявлении в четверг. «Но, учитывая значительную ценность, которую технология Anthropic предоставляет нашим вооруженным силам, мы надеемся, что они пересмотрят свое решение».

Это противостояние подчеркивает растущую реальность того, что частные компании, разрабатывающие передовой искусственный интеллект, могут попытаться установить свои собственные ограничения на то, как технология может быть развернута даже в контексте национальной безопасности.

В июле Министерство обороны заключило контракты на сумму до 200 миллионов долларов с четырьмя компаниями – Anthropic, OpenAI, Google DeepMind и XAI Илона Маска – на создание прототипов передовых возможностей искусственного интеллекта, связанных с приоритетами национальной безопасности США. Награды свидетельствуют о том, насколько агрессивно Пентагон продвигается по внедрению передового коммерческого искусственного интеллекта в оборонные операции.

Эта срочность также отражена во внутреннем планировании Пентагона. В меморандуме от 9 января, описывающем стратегию армии в области искусственного интеллекта, содержится призыв к США стать боевой силой, ориентированной на искусственный интеллект, и ускорить интеграцию ведущих коммерческих моделей искусственного интеллекта в боевые, разведывательные и корпоративные операции.

«В этом нет победителей», — сказала CNBC в недавнем интервью Лорен Кан, старший аналитик-исследователь Джорджтаунского Центра безопасности и новых технологий, о противостоянии между Пентагоном и Anthropic. «Это оставляет кислый привкус во рту».

Однако то, что он делает, знаменует собой перемену – отход от десятилетий оборонных инноваций, в течение которых правительства сами контролировали технологии по мере их создания.

«На протяжении большей части периода после Второй мировой войны правительство США определяло пределы передовых технологий», — сказал контр-адмирал Лорин Селби, бывший глава военно-морских исследований и нынешний генеральный партнер Mare Liberum, инвестиционной компании, специализирующейся на морских технологиях и инфраструктуре. «Он устанавливал требования, финансировал фундаментальные исследования и управлял промышленностью в соответствии с правительственными спецификациями. От ядерных двигателей до малозаметности и GPS, государство было основным двигателем открытий, а промышленность была интегратором и создателем».

По словам Селби, искусственный интеллект опроверг эту модель.

«Сегодня коммерческий сектор является основной движущей силой передовых возможностей. Частный капитал, глобальная конкуренция и масштаб коммерческих данных развивают ИИ такими темпами, которые традиционные правительственные структуры исследований и разработок не могут легко воспроизвести. Военное министерство больше не определяет пределы того, что технически возможно в искусственном интеллекте — оно владеет им», — сказал он.

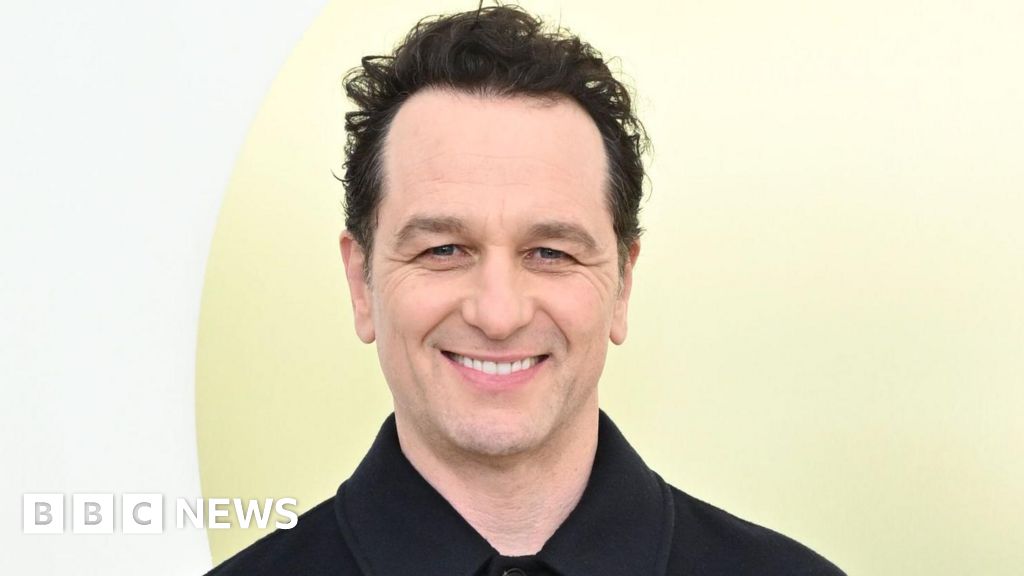

Военный министр США Пит Хегсет выступает во время визита в Sierra Space в Луисвилле, штат Колорадо, в понедельник, 23 февраля 2026 года.

Аарон Онтиверос | Денвер Пост | изображения Гетти

Такое изменение баланса сил над технологиями несет в себе как возможности, так и риски.

«Мы не должны оказаться в месте, где частные компании чувствуют, что они доминируют над правительством США или западными союзниками из-за технологических возможностей, которые они предоставляют», — сказал Джо Шайдлер, бывший заместитель директора Белого дома и специальный советник, а также соучредитель и генеральный директор стартапа в области искусственного интеллекта Helios. «Технологи могут и должны создавать и делать это ответственно, но правительства должны быть субъектом, принимающим решения».

Anthropic и Министерство обороны не ответили на запросы о комментариях.

Зачем военным нужен частный ИИ?

От промышленной мобилизации во время Второй мировой войны до современных программ аэрокосмической и кибербезопасности, государственно-частное партнерство уже давно поддерживает американские оборонные инновации. Но искусственный интеллект отличается тем, что самые передовые возможности все больше концентрируются в коммерческих фирмах, а не в государственных лабораториях.

«Сильное государственно-частное партнерство – это то, что дает Америке преимущество», – сказал Шайдлер. «Вы не найдете более динамичного и инновационного кадрового резерва, чем американское предпринимательское сообщество. Идея попытаться воспроизвести такой уровень инноваций внутри самого правительства… сложна».

Именно из-за этой концентрации правительства стремятся к партнерству, но, по мнению Селби, зависимость также обусловлена прежде всего скоростью. Он сказал: «Инновационные циклы в венчурных компаниях длятся месяцами. Традиционные циклы поглощений длятся годами. Без коммерческих поставщиков ИИ правительство будет работать медленнее, менее адаптивно и гораздо дороже».

Когда критически важные инструменты национальной безопасности разрабатываются частными компаниями, «главное изменение заключается в том, что правительство больше не полностью контролирует разработку своих самых передовых технологических инструментов», — сказала Бетси Купер, директор Политической академии Аспена и бывший адвокат-консультант Министерства внутренней безопасности США.

Купер сказал, что коммерческие системы искусственного интеллекта обычно создаются для более широких рынков, а не для военных миссий, что может создать разрыв между тем, как компании разрабатывают свои технологии, и тем, как правительства хотят их внедрить.

Эта путаница может стать более явной, когда корпоративная политика, репутационные проблемы или глобальное давление со стороны клиентов вступают в противоречие с целями правительства, как это сейчас видно в спорах об антропогенном факторе.

Купер сказал: «Если компании используют свою продукцию по весьма противоречивым причинам – например, для создания автономного летального оружия или для проведения превентивных убийств до совершения преступлений, они, возможно, не захотят рисковать негативной реакцией со стороны своей клиентской базы».

Правительство имеет долгосрочные выгоды

Несмотря на переход к коммерческим технологиям, руководители оборонных ведомств вряд ли откажутся от контроля над критически важными системами.

«Первое, что нужно понять, это то, что, судя по тому, что я видел на сегодняшний день, Министерство обороны не собирается отказываться от окончательного контроля», — сказал Брэд Харрисон, основатель Scout Ventures, венчурной компании на ранней стадии, которая инвестирует на стыке национальной безопасности и критических технологических инноваций. «Правительство по-прежнему хочет понять все, что связано с этим, все зависимости и риски».

Харрисон, бывший рейнджер армии США и выпускник Вест-Пойнта, сказал, что ИИ в конечном итоге может влиять на такие решения, как прекращение входящих угроз, поэтому «правительство будет крайне осторожно относиться к тому, как они позволяют ИИ взаимодействовать с этими уровнями данных», — сказал он. «Никто не хочет быть ответственным за Скайнет», — сказал он, имея в виду вымышленный искусственный интеллект из вселенной «Терминатора», который стал причиной ядерной войны.

Правительства также обладают мощными инструментами влияния на компании, включая решения о закупках, экспортный контроль и регулирующие органы. «Правительство имеет слишком большое влияние», – сказал Харрисон. «Если вы не хотите с ними работать, у них есть много способов сделать это очень трудным решением», — сказал он.

Но, по словам Селби, рычаги воздействия действуют в обоих направлениях, по крайней мере, на данный момент. Он сказал: «В краткосрочной перспективе компании, у которых мало специалистов в области искусственного интеллекта и собственных моделей, могут оказать значительное влияние. В долгосрочной перспективе суверенные правительства сохраняют регулирующие полномочия, право заключения контрактов, масштабы финансирования и, при необходимости, юридические обязательства».

По мнению Селби, самый важный вопрос заключается в том, «сможем ли мы построить устойчивый государственно-частный договор, который будет рассматривать ИИ как фундаментальную инфраструктуру национальной безопасности, а не просто еще одно сотрудничество с поставщиками».

Риски в новом военно-промышленном комплексе Кремниевой долины

Эксперты говорят, что в конечном итоге проблема заключается не столько в том, получают ли компании или правительства долгосрочные выгоды, сколько в том, как развиваются отношения по мере того, как ИИ оказывается в центре национальной власти.

«Если мы создадим согласованность и гибкость в государственно-частных отношениях, ИИ сможет укрепить национальную безопасность, сохраняя при этом инновации», — сказал Селби. Он сказал: «Если мы не сможем этого сделать, мы рискуем получить будущее, в котором потенциал изобилует, но согласованность хрупка».

В формирующемся военном промышленном комплексе Кремниевой долины существует множество новых форм риска. Например, использование искусственного интеллекта внешней разработки может создать уязвимости, если система неожиданно выйдет из строя или станет недоступной, особенно если военные подразделения привыкнут к ним во время операций.

«Чрезмерная зависимость может оказаться фатальной», — сказал Шанка Джаясинха, основатель Onto AI, компании, которая разрабатывает инструменты искусственного интеллекта для армии, здравоохранения, финансовых организаций и корпоративных решений. Он описал сценарии, в которых подразделения специальных операций во время развертывания полагаются на инструменты координации миссий, дополненные искусственным интеллектом. Если эти системы выйдут из строя после длительного использования, «многие жизни окажутся под угрозой», сказал он.

Привязка к поставщику является еще одной проблемой. Поскольку платформы искусственного интеллекта внедряются в рабочие процессы, их может стать труднее заменить. «При нынешних темпах прогресса в области искусственного интеллекта трудно заменить кого-либо из действующих лиц», — сказал Джаясинха.

Однако, по словам Харрисона, есть один риск, которому Пентагон не подвергнет себя, — это стать заложником одной-единственной компании. «Правительство США не собирается полагаться ни на одну компанию Кремниевой долины, — сказал он, — они будут тестировать систему очень систематически, контролировать уровень данных и двигаться шаг за шагом».

Генеральный директор OpenAI Сэм Альтман, у которого были спорные отношения с Anthropic и Amodei, в четверг выступил с заявлением для своих сотрудников, предлагая некоторую поддержку на уровне коллег «красным линиям» соперника ИИ, которые находятся в центре конфликта с Пентагоном.

Но Пентагон опубликовал свое собственное очень четкое заявление о важности Anthropic или любой другой компании, а заместитель военного министра по исследованиям и технике Эмиль Мишель написал в своем посте в Твиттере в четверг вечером: «Жаль, что @DarioAmodei — лжец и у него комплекс Бога. Он не хочет ничего, кроме как попытаться лично контролировать вооруженные силы США и подвергает риску безопасность нашей страны. @DeptofWar всегда будет следовать закону. Но не подчинится чьим-либо прихотям». прибыльная технологическая компания».

Anthropic заявила, что, если правительство «выключит» Anthropic, «мы будем работать над тем, чтобы обеспечить плавный переход к другому поставщику, чтобы избежать каких-либо сбоев в текущем военном планировании, операциях или других важных миссиях».

Одним из подходов, который, вероятно, получит еще большее внимание в будущем, является создание того, что некоторые технологии называют «суверенными архитектурами искусственного интеллекта» — систем, предназначенных для того, чтобы позволить правительствам сохранять независимость от поставщиков, одновременно получая выгоду от коммерческих инноваций.

«Мы много говорим внутри компании об идее суверенной разведки и независимости поставщиков», — сказал Шайдлер, утверждая, что экосистема США достаточно широка, чтобы предотвратить чрезмерную зависимость от какого-либо одного поставщика. «Новые идеи появляются ежедневно, и нам не нужно полагаться на какого-то одного поставщика», — сказал он.