Плата за подписку на ИИ нравится не всем, и с учетом роста стоимости подписки на ИИ поначалу это может оказаться не такой уж хорошей идеей. Если вы приобрели годовую подписку на Perplexity, вас обманули, и ежемесячная плата в размере 20 долларов за любую подписку на AI быстро увеличится.

Поскольку квантованные модели становятся все более популярными, существует очень большая вероятность, что вы сможете запустить мощный ИИ локально на своем существующем компьютере. К счастью, существует множество бесплатных инструментов, которые позволяют запускать массу мощных моделей искусственного интеллекта на собственном оборудовании без какой-либо подписки.

Олама

После установки перетащите модель как пакет.

Если вам комфортно работать с командной строкой, Olama — это самый быстрый способ запустить локальный LLM. Установите его, откройте терминал и введите Олама беги [model name] И в вашем окне терминала работает локальный ИИ. Например, если вы хотите запустить модель Llama 3 с открытым исходным кодом из Meta, используйте следующую команду:

ollama run llama3

Olama был разработан с учетом API, и именно так он работает. При этом на вашем компьютере создается локальный REST API, совместимый с форматом OpenAI. Это означает, что любое приложение или скрипт, который вы создаете для ChatGPT, можно использовать в вашей локальной модели с минимальными изменениями кода. Он позиционирует себя не как чат-бот, а как целую инфраструктуру, что является одной из причин его популярности среди разработчиков.

Приложение поддерживает более 30 оптимизированных моделей, включая Llama3, DeepSeek, Mistral и Phi-3. Он работает в Windows, macOS и Linux и использует лишь минимальный объем системной памяти по сравнению с другими инструментами. Единственный компромисс заключается в том, что он не имеет графического интерфейса, поэтому, если терминал вас беспокоит, вам придется попробовать другие варианты.

- ОС

-

Windows, МакОС, Линукс

- разработчик

-

Олама

- модель стоимости

-

бесплатный, с открытым исходным кодом

Облегченная локальная среда выполнения, позволяющая загружать и запускать большие языковые модели на вашем компьютере с помощью одной команды.

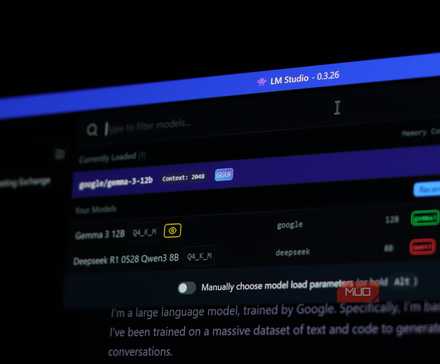

ЛМ Студия

Загрузите и запустите модели искусственного интеллекта, например приложения, на своем телефоне.

Если вы предпочитаете работать с графическим интерфейсом, LM Studio — одно из самых простых в использовании приложений. Он вызывает интерфейс рабочего стола, где вы можете напрямую просматривать Hugging Face, загружать квантованные модели и настраивать системные сигналы без необходимости использования файла конфигурации.

Он также имеет такие функции, как безголовый демон для развертывания сервера, параллельные запросы вывода с непрерывной пакетной обработкой и новый REST API с отслеживанием состояния и поддержкой локального сервера MCP. Однако для повседневного использования главной функцией по-прежнему является поиск модели. Вы можете искать, сравнивать и скачивать модели, отсортированные по размеру, производительности и совместимости, не выходя из интерфейса приложения.

LM Studio также включает в себя локальный сервер, который предоставляет API-интерфейсы, совместимые с OpenAI, на вашем компьютере, поэтому он также служит серверной частью для других инструментов. Он поддерживает графические процессоры Nvidia и Apple Silicon и включает встроенные функции тестирования, позволяющие сравнить производительность различных моделей на вашем конкретном оборудовании. Обратной стороной является то, что это приложение на базе Electron, поэтому оно использует больше оперативной памяти в дополнение к аппаратному потреблению модели.

- ОС

-

Windows, МакОС, Линукс

- разработчик

-

Элемент Лаборатории

- модель стоимости

-

Бесплатно

Бесплатное настольное приложение, которое позволяет загружать, запускать и общаться с большими языковыми моделями локально, без необходимости в облаке.

GPT4Все

Самая простая точка входа в оффлайн LLM

GPT4All — еще один удобный вариант для быстрого запуска локального ИИ на вашем ПК. Если вы никогда раньше не запускали собственную модель искусственного интеллекта и эта идея звучит устрашающе (сравнение нескольких моделей на обнимающемся лице может помочь), тогда начните здесь. Скачайте приложение, откройте его, выберите модель из встроенного списка и мгновенно начните общение.

Отличительной особенностью здесь является LocalDocs, встроенная система RAG (дополненная генерация поиска). Наведите его на папку с PDF-файлами, текстовыми файлами или документами Markdown, и он автоматически все проиндексирует. Когда вы задаете вопрос, модель извлекает соответствующие выдержки из ваших файлов, а не полагается только на свои обучающие данные.

GPT4All также довольно хорошо работает на одном процессоре, что делает его идеальным для ноутбуков или старых компьютеров, у которых нет мощного оборудования, необходимого для более крупных моделей искусственного интеллекта. Он доступен в Windows, macOS и Linux. Однако то, что вы получаете в простоте использования, вы теряете в гибкости — нет детального контроля над эталонным окном и настройками квантования, которые предоставляют Olama и LM Studio.

- ОС

-

Windows, МакОС, Линукс

- разработчик

-

номинальный ИИ

- модель стоимости

-

бесплатный, с открытым исходным кодом

Бесплатная собственная платформа искусственного интеллекта с открытым исходным кодом, которая запускает большие языковые модели на вашем ПК без облачных зависимостей.

январь

Ян переносит возможности ChatGPT на ваш рабочий стол

Jana использует подход, отличный от других инструментов, в том смысле, что она не просто занимается LLM, а стремится стать полноценной автономной платформой-помощником с чистым интерфейсом, похожим на ChatGPT. Он полностью с открытым исходным кодом и изначально разработан с учетом конфиденциальности, поэтому даже если вы чувствуете, что у вас есть готовый продукт, ваши данные в безопасности.

Настройка тоже очень проста: скачайте Jan, выберите модель, подходящую вашему оборудованию (приложение поможет вам выбрать, если вы не можете определиться) и начните общаться. Он также напрямую интегрируется с Hugging Face, позволяя просматривать и загружать такие модели, как Quen, Llama и Mistral, прямо из пользовательского интерфейса. Подобно Olama и LM Studio, Джаан также настраивает локальный сервер API на порту 1337, который имитирует API OpenAI, позволяя вам подключить его к VS Code для создания локальных помощников по кодированию на основе искусственного интеллекта, интеграции с пользовательскими скриптами или чего-либо еще, что работает через HTTP.

Программа работает в автономном режиме после загрузки модели. Он также поддерживает Windows, macOS и Linux и работает на универсальном движке Cortex. Если вам нужен максимально приближенный к ChatGPT опыт без его фактического использования, Ян — очень хороший вариант.

- ОС

-

Windows, МакОС, Линукс

- разработчик

-

январь

- модель стоимости

-

бесплатный, с открытым исходным кодом

Бесплатный чат-помощник на основе искусственного интеллекта с открытым исходным кодом, который запускает локальные модели больших языков на вашем ПК без необходимости в облаке.

Управлять локальным ИИ стало проще, чем когда-либо

Квантованные модели позволяют запускать большие модели ИИ на скромном оборудовании, и существует множество приложений, которые позволяют вам наслаждаться ИИ локально на вашем ПК. Тем не менее, вам все равно необходимо соответствовать определенным требованиям к оборудованию для правильной работы этих моделей.

Я никогда больше не буду платить за ИИ

Искусственный интеллект не должен стоить вам ни копейки — собственные модели быстры, конфиденциальны и в конечном итоге стоят того, чтобы их переключить.

В общем, восьми гигабайт памяти и современного процессора вам хватит. Но для более крупных моделей и лучшего опыта рекомендуется использовать 16 ГБ ОЗУ, выделенный графический процессор с объемом видеопамяти не менее 8 ГБ и твердотельный накопитель для хранения моделей и данных.

Оплата подписки на ИИ теперь является возможностью, а не требованием. Являетесь ли вы разработчиком, которому нужен контроль API, пользователем, заботящимся о конфиденциальности, который не хочет, чтобы данные покидали ваш компьютер, или кем-то, кто просто хочет поэкспериментировать, не платя за подписку, есть приложение, которое позволит вам использовать локальный ИИ так, как вам нужно.